Higgsfield motion control を調べている人が本当に求めているものは、たいてい一つです――「もっとコントロールしたい」ということです。数秒だけ派手に見えるAI動画が欲しいわけではありません。意図が感じられる動き、破綻しないキャラクターのモーション、そして元のアイデアから大きくブレない結果を求めています。

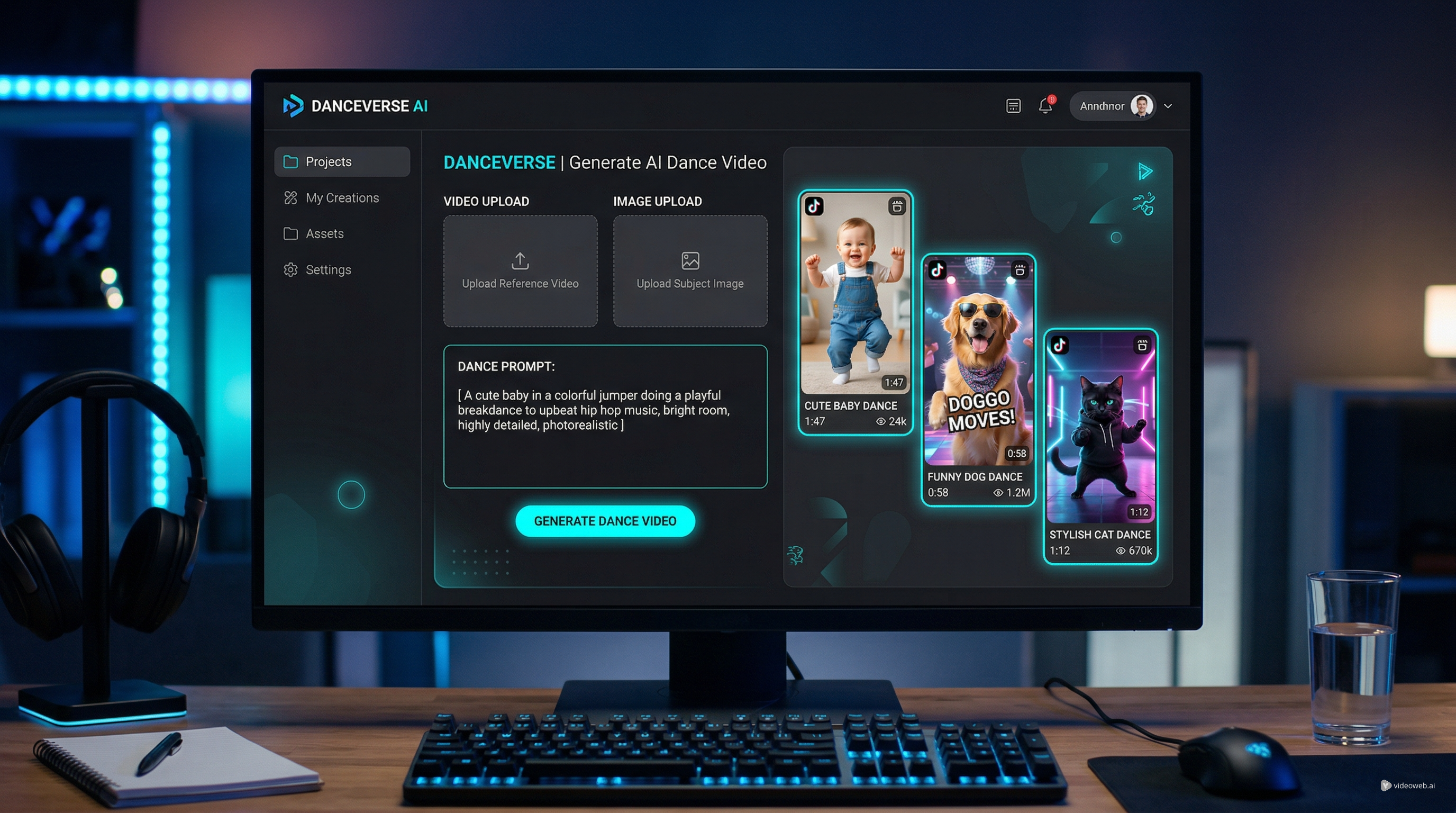

そこで役立つのが、優れたモーションコントロール動画ジェネレーター です。AIFacefy では、Kling Motion Control を中心にワークフローが組まれており、被写体画像とモーションリファレンス動画を組み合わせて、最終結果がより明確なパフォーマンスパターンに沿うようにできます。テキストプロンプトだけに「うまく解釈してくれ」と祈るのではなく、最初からモデルに強いガイダンスを与えられるわけです。

このガイドでは、モーションコントロールとは実際何なのか、なぜ重要なのか、どう使えばうまくいくのか、そして同じクリエイティブワークフローからより良い結果を引き出すために、他にどの AIFacefy ツールが役立つのかを解説していきます。

Higgsfield Motion Control とは、実際のところ何か?

簡単に言えば、モーションコントロールとは「参照用のモーションクリップを使って、キャラクターや被写体の動きをガイドする」AI動画手法です。これは、プロンプトだけで生成する一般的な方法とは大きく異なります。プロンプトのみのツールでは、あなたは動きを言葉で説明し、モデルがそれをうまく解釈してくれることを祈るしかありません。一方、Kling Motion Control AI では、実際のモーションソースに基づいて動きが決まるため、出力はより「演出された」感じになり、一貫性も高くなります。

そのため、多くのクリエイターは、ボディランゲージやジェスチャー、表情、繰り返し可能なアクションに依存するコンテンツ制作において、AI モーションコントロール動画 のワークフローを好みます。キャラクターアニメーション、広告モック、スタイライズされたパフォーマンスクリップなどを作るときには、強いモーションガイドがあることで、かなりのストレス軽減になります。

別の見方をすると、プロンプトだけの動画生成は「素早いアイデア出し」には向いている一方で、制御された AI 動画生成 は「連続性が重要なとき」に向いていると言えます。

なぜモーションコントロールが本気のクリエイターにとって重要なのか

多くのAI動画の最大の問題は、「見た目が悪い」ことではありません。「不安定である」ことです。ポーズが瞬間ごとに変わりすぎる。顔の一貫性が失われる。ジェスチャーが最初は良いのに、途中から妙な動きにズレていく。クリエイターにとってこれは、リトライの増加、クレジットの無駄遣い、「あと一歩届かない」出力を直すための時間増大につながります。

優れたキャラクターモーションコントロールツール は、モデルに「物理的なパフォーマンスパターン」を与えることで、こうした問題の多くを解決します。これは、さまざまなタイプのクリエイターにとって意味のあることです。

ソーシャルメディアクリエイターにとっては、動きがきれいでキレのあるショートクリップが作りやすくなります。マーケターにとっては、被写体に特定のアクションをさせたい広告コンセプトの精度が上がります。ストーリーテラーにとっては、アニメーションシーンがランダムではなくなります。キャラクターアーティストにとっては、モーションを別ソースから転写しても「キャラクターの個性」を保ちやすくなります。

こうした理由から、モーションコントロールは「ちょうどいい中間解」として魅力を増しています。テキストのみの動画生成よりは格段に指示が通りやすい一方で、完全手作業のアニメーション制作よりははるかに高速です。

AIFacefy のワークフローの仕組み

AIFacefy のプロセスは、直感的でわかりやすいのも魅力です。まず、モーションリファレンスとなる動画クリップをアップロードします。次に、アニメーションさせたい被写体画像をアップロードします。そのうえでプロンプトを入力し、生成を実行します。

実際には、モーションリファレンスが「被写体がどう動くか」をモデルに教え、画像が「被写体がどう見えるか」を伝えます。プロンプトは、スタイル・ムード・環境・仕上げのディテールを形作る役割です。

このバランスが重要です。モーションクリップは「動き」のためにあり、プロンプトはその動きを「支える」ためにあります。テキスト側で矛盾するアクションを詰め込みすぎると、出力が弱くなりがちです。

そのため、多くのユーザーがこのワークフローにImage to Prompt を組み合わせています。すでに強いビジュアルリファレンスはあるものの、それを言語化するのが難しい場合、このツールを使えば視覚的なアイデアを「再利用可能なプロンプト言語」に変換できます。

うまく使うためのシンプルなステップバイステップ

第一段階は「きれいなモーションリファレンス」を選ぶことです。複雑でゴチャついた動きよりも、「体の動きがはっきり読み取れる短いクリップ」のほうが通常は良い結果につながります。モーションが複雑すぎると、出力が不安定になりやすいからです。

第二段階は「強い被写体画像」を使うことです。画像がクリアであるほど、モデルはアニメーション中も被写体をしっかり保てます。もし、よりクリーンな出発点が必要であれば、AI Image Generator を使ってからアニメーションに進むのが効果的です。

第三段階は「支援的なプロンプト」を書くことです。ビジュアルスタイル、服装、ライティング、ムード、カメラの雰囲気、シーンの文脈にフォーカスしましょう。動きそのものはモーションリファレンスに任せます。矛盾だらけの長文よりも、短くフォーカスされたプロンプトの方がうまくいく場合が多いです。

第四段階は「ブラッシュアップ」です。最初の結果が「悪くないけれど、あと少し足りない」というとき、すぐにアイデアごと捨ててしまう必要はありません。元画像を改善したり、プロンプトをシンプルにしたりするだけで、二回目の結果が大きく飛躍することがあります。

アニメーション前に、より高いレベルで元画像を整えたいクリエイターには、Flux Kontext AI が便利です。入力ビジュアルを磨き上げることで、アニメーションを「より安定して魅力的な画像」からスタートさせられます。

本当に役に立つプロンプトのコツ

初心者がよくやりがちなミスがあります。それは「モーションクリップで動きを指定しているのに、プロンプトではそれと完全に別の動きを要求してしまう」ことです。これはモデルを混乱させます。

より良いアプローチは、「スタイルとシーンを支えるプロンプト」を書くことです。被写体の特徴、全体的なムード、服装、ライティング、背景の雰囲気、欲しいショットのタイプを描写します。例えば、「キャラクターがジャンプして、スピンして、ターンして、派手に手を振る」といった動きはリファレンスクリップに任せ、プロンプトでは「シネマティックなネオンシティの背景、柔らかな青い光、スタイリッシュなストリートウェア、エネルギッシュなCM風の雰囲気」のように書く、というイメージです。

こうした考え方でプロンプトを書くと、ワークフローが格段に直感的になります。モーションリファレンスは「パフォーマンス」を、プロンプトは「見せ方」を担当するのです。

特に洗練されたビジュアルを事前に用意したい場合には、Seedream 4.5 AI や Nano Banana Pro AI も検討する価値があります。これらは、アニメーションに適したクリーンな元画像を生成・ブラッシュアップするのに役立ちます。

他の動画モデルではなく、いつモーションコントロールを使うべきか

すべてのプロジェクトにモーションコントロールが必要なわけではありません。より汎用的な動画モデルで十分な場合もあります。重要なのは、「自分がどのレベルのコントロールを本当に必要としているか」を見極めることです。

ポーズの正確さ、ジェスチャーの転写、被写体主導のパフォーマンスが最優先なら、Kling Motion Control AI を選びましょう。特に「被写体にどう動いてほしいか」がすでに明確な場合に力を発揮します。

より一般的な動画生成ワークフローで、そこまで強いモーションガイドが不要な場合は、Kling 3.0 AI video generator を選ぶと良いでしょう。

より広い参照情報に基づく一貫性が欲しい、マルチモーダルな動画ワークフローを求めるなら、Seedance 2.0 video generator が適しています。

細かな身体の動き、表情のニュアンス、表現力豊かなシーン描写を重視するなら、Hailuo 2.3 AI video を選ぶのが良いでしょう。

よりシネマティックなAI動画、特にオーディオと連動した表現に興味があるなら、Veo 3 AI video generator が向いています。

要するに、モーションコントロールは万能ではありません。「動きそのもの」が主要なクリエイティブゴールの一つになっているプロジェクトの回答なのです。

AIFacefy で使えるベストなコンパニオンツール

AIFacefy の強みの一つは、モーションコントロールを「単独ツール」として扱う必要がないことです。その周りに、よりリッチな制作パイプラインを組み立てられます。

もっとシンプルな出発点が欲しい場合は、Photo to Video AI generator が良い橋渡しになります。いきなり高度なコントロールワークフローに飛び込むのではなく、静止画像を手軽にアニメーション化したい初心者に向いています。

まだ被写体のビジュアルアイデンティティを構築している途中なら、GPT Image 1.5 を使うことで、動画に進む前の柔軟な画像生成・編集が可能になります。

もし目的が「完成度の高い元アートの作成」であれば、AI Image Generator、Seedream 4.5 AI、Nano Banana Pro AI のいずれも有力なスタート地点です。求めるスタイルや仕上がりの精度に応じて使い分けられます。

そして、ビジュアルを言葉で説明するのが苦手な場合には、Image to Prompt がプロセス全体の中で最も実用的なサポートツールの一つになります。

避けるべきよくある失敗

第一の失敗は、「弱い被写体画像」を使ってしまうことです。画像がぼやけていたり、一貫性がなかったり、構図が悪かったりすると、アニメーション側が活かせる情報が少なくなってしまいます。

第二の失敗は、「モーションリファレンスがごちゃごちゃしすぎている」ことです。複雑なアクションよりも、クリアな動きのほうが転写しやすい傾向があります。

第三の失敗は、「プロンプトの詰め込みすぎ」です。プロンプトはスタイルを導くためのものであり、モーションクリップと競合する追加アクションでシステムを埋め尽くすべきではありません。

第四の失敗は、「事前準備を飛ばしてしまう」ことです。凡庸な結果と強い結果を分けるのは、必ずしも生成そのものではありません。その前段階にある「ビジュアルの仕込み」の質である場合がよくあります。

だからこそ、motion control video generator のワークフローと画像準備ツールを組み合わせると、全体としてより良いアウトプットにつながりやすいのです。

まとめ

もしあなたがHiggsfield motion control を探しているのが、「AI動画の動きをもっと安定させたい」からだとしたら、AIFacefy の Kling Motion Control ワークフローはとても実用的な出発点になります。モーションリファレンス=アクション、被写体画像=アイデンティティ、プロンプト=スタイル、という明確なクリエイティブ構造を与えてくれるからです。

この構造によって、AI動画は「ランダムなもの」ではなく、はるかに「使えるもの」へと変わります。

多くのクリエイターにとって賢いアプローチは、これをより大きなパイプラインの一部として扱うことです。まず強い元画像を用意し、必要に応じて磨き上げ、モーションコントロールでアニメーション化し、そのうえでプロジェクト内容に応じて Kling 3.0 AI video generator、Seedance 2.0 video generator、Photo to Video AI generator、GPT Image 1.5 などの隣接ツールを検討する、という流れです。

より高いコントロール性、一貫性、予測しやすいクリエイティブワークフローを目指すなら、モーションコントロールは単なる流行ではありません。いま AI 動画クリエイターが取り入れられる、最も有用なアップグレードの一つと言えるでしょう。